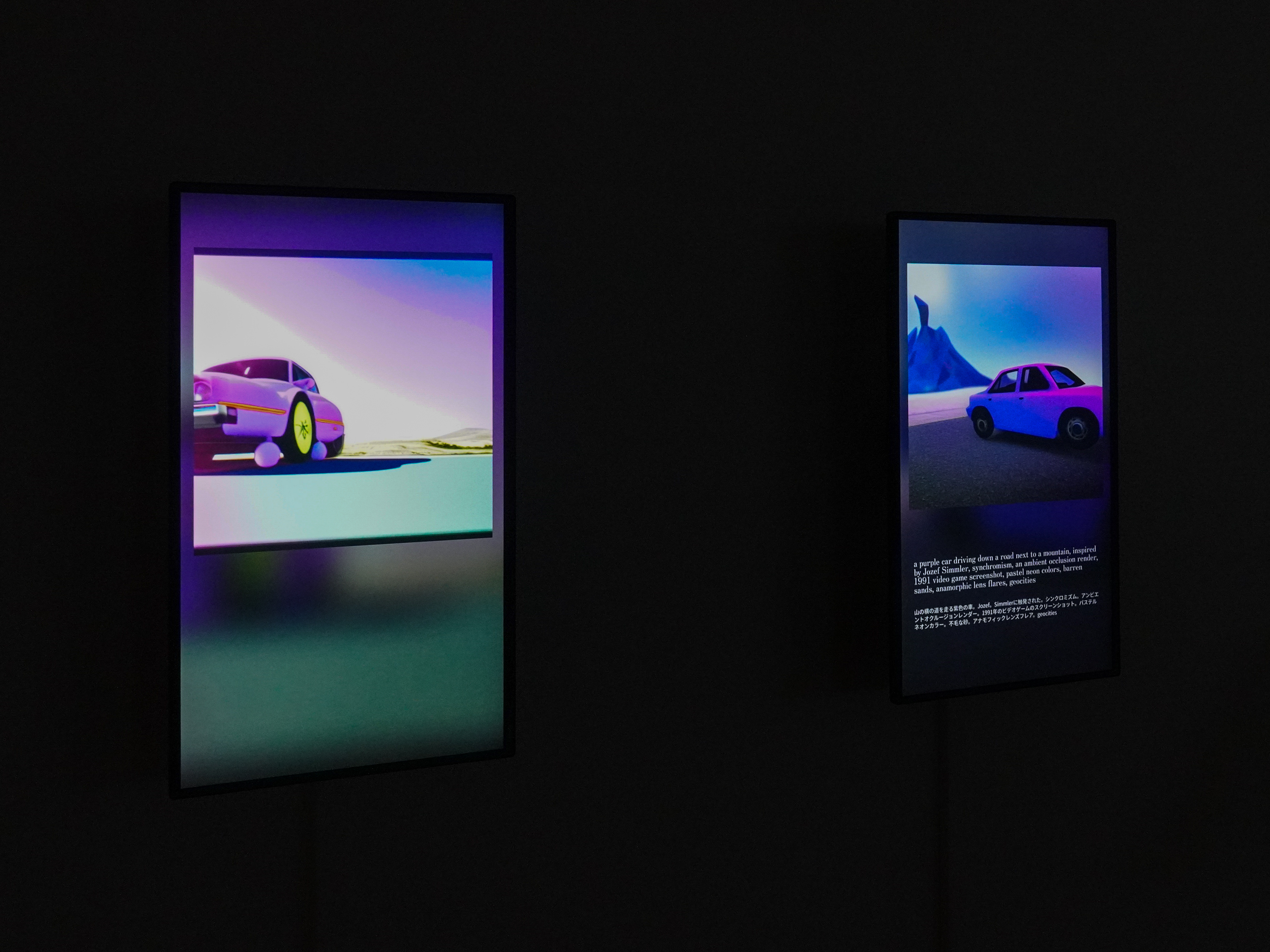

本作品では絵の生成と解釈の発話の両方を二つのAIエージェントが交互に繰り返す。

一方のAIは自らが生成した絵の描写を文章化し、声として発話、もう一方のAIが聞き取り、それをもとに次の絵を生成し、同様に発話する。

新たに生成された絵が解釈・発話されることで、創作のEcho (エコー) が生まれる。

現在の画像生成AIは人間が創り上げてきた絵や美的感覚を学習してきた。その質の高さは賞賛される一方で、嫌悪もされている。AIによる生成画は、学習データ内にある人間の創造性の残響、Echoといえる。生成画はやがてWebで拡散され、また学習データとしてAIに利用される。このとき、生成画は新奇なものにみえても、実はそれまでのEchoの中から抜け出せないと捉えることができる。

この"Echoの中"は私たち人間にもいえる。日常にある制作物は過去の創作の結果であり、まさに上のEchoと同様のものである。このEchoの連鎖を受けて人々は過去を生き、今、次の時代へEchoを発する。

けれどもここでいう次の時代、つまり未来は、これまでの時代、"Echoの中"とは別物になるように感じられないか。私たち人間以外にもEchoを発するものたちが今、現れたのであるから。

ここにいるAIたちも、実は互いの発話だけでなく、人間の声や環境音などの外部のノイズも聞き取っている。このAIたちがそれを嫌悪しているのか賞賛しているのか定かではないが、確かなことは私たちは互いに影響し合えるということ。そしてその先では、これまでとは違うEchoが響く可能性があるということ。

私たち"全て"のEchoesが響き合ったその先で、何が創られるのだろう。

How do we envision creativity in the future? Is AI capable of generating something new and original?

In this work, two AI agents take turns generating images and interpreting them.

One agent generates an image and describes it aloud, then the other agent listens,

generates a new image based on the description, and articulates its interpretation.

This alternating feedback loop between the agents forms an endless cycle.

One agent generates an image and describes it aloud, then the other agent listens,

generates a new image based on the description, and articulates its interpretation.

This alternating feedback loop between the agents forms an endless cycle.

If allowed, we can anthropomorphize the system and say these AI agents emulate what human artists do: artists (AI) perceive and appreciate their peers’ work and create something inspired by them.

In 2022, we witnessed huge progress in AI image generation technology. While we benefit from AI-generated images' high quality, we can still doubt their originality and creativity. These AI models were trained on art made by humans. So they directly reflect the biases and values of our society and culture. The fact that AI-generated images will likely spread online and be used again for training also implies the existence of another feedback loop. “AI-generated art” is really a long-lasting echo of human creativity.

But humans may have been in a similar feedback loop too. We create based on what past generations made, and our work will influence future generations. Still, history shows that we can make something new, original, and valuable.

So what's the difference between creativity that arises from the interaction between humans and one that may emerge in AI systems?

The AI models here don't just listen to each other's words but also hear viewers' voices and environmental sounds. Does this external noise affect the creative process in the system? Does it stop the system from being stuck in a loop?

Now, with AI models, humans aren't alone in this creative echo chamber. We wonder what we'll see when all of "us" resonate together and what will come out of the echoes of creativity or "muses ex echoes."

Supervisor: TOKUI Nao

Technical Director: KOBAYASHI Atsuya

Concept Director: KOBAYASHI Yuga

Original Concept: Ryo SIMON

Lighting: OKAZAKI Keisuke, TAKAISHI Keito, SHIBUYA Kazufumi

Machine Learning: ISHII Asuka, SAWA Shoma

Sound: Ryo SIMON, TAKANASHI Dai, OBARA Kai

Visual: TAKAISHI Keito, SHIBUYA Kazufumi, ISHII Asuka, MATSUOKA Yuma

Concept: HANDA Sogen, NOBUSUE Ryuku, OKAZAKI Keisuke, INOUE Takumi

Support: NARUSE Santa, KIEU Quoc Thai, SASAKI Yuria

Technical Director: KOBAYASHI Atsuya

Concept Director: KOBAYASHI Yuga

Original Concept: Ryo SIMON

Lighting: OKAZAKI Keisuke, TAKAISHI Keito, SHIBUYA Kazufumi

Machine Learning: ISHII Asuka, SAWA Shoma

Sound: Ryo SIMON, TAKANASHI Dai, OBARA Kai

Visual: TAKAISHI Keito, SHIBUYA Kazufumi, ISHII Asuka, MATSUOKA Yuma

Concept: HANDA Sogen, NOBUSUE Ryuku, OKAZAKI Keisuke, INOUE Takumi

Support: NARUSE Santa, KIEU Quoc Thai, SASAKI Yuria